Integrationen

Pryvet lässt sich in die unterschiedlichsten Systeme integrieren, um Sie ideal mit datenschutzgerechter KI-Power zu unterstützen.

Eine API für eine Vielzahl von Large-Language-Models

Bei Pryvet benötigen Sie nur eine Schnittstelle, um auf eine Vielzahl von state-of-the-art LLMs zugreifen zu können.

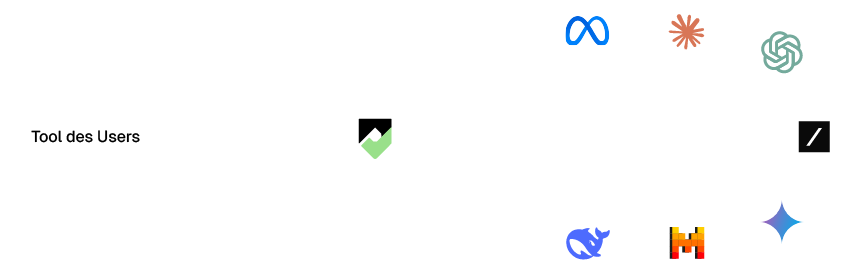

Sicheres Plug & Play LLM

Binden Sie die Pryvet LLMs in Ihre bestehenden Systeme, Tools und Prozesse als Plug & Play Ersatz zu anderen Large Language Models ein. Hierdurch können Sie die gewohnte Qualität Ihrer bevorzugten LLMs gepaart mit den Pryvet Security-Layern einsetzen.

Die sichere Schnittstelle von Pryvet bietet einen vergleichbaren technischen Funktionsumfang, Endpunkte und Parameter an, die Sie bereits aus der Anbindung von populären Foundation Modellen wie denen von OpenAI, Google, Mistral Anthropic und Co. kennen.

-

Nahtlose Integration

-

Vertraute API-Endpunkte

-

Schutz durch Sicherheitslayer

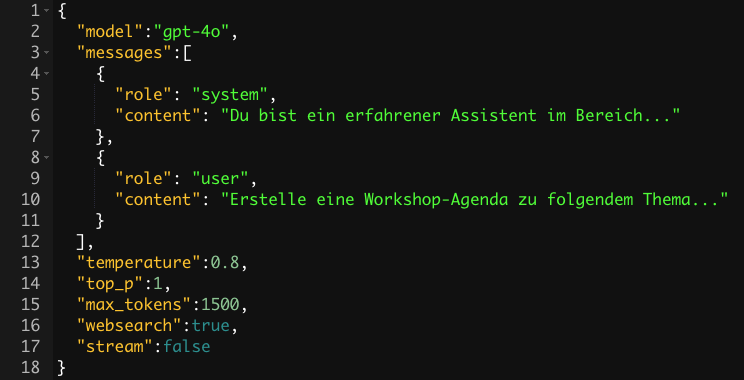

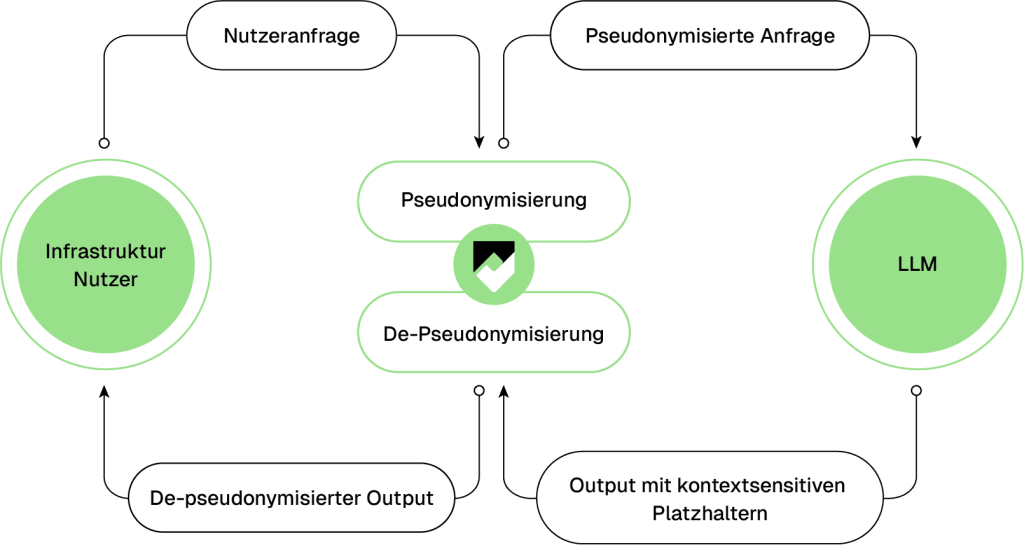

Nutzeranfrage

Von Nutzerseite wird eine Anfrage an den Chatbot erstellt. Diese enthält sensitive Daten.

Pseudonymisierung

Das zwischen Nutzer und Large Language Model geschaltene Pryvet Security Layer erkennt die sensitiven Daten und ersetzt diese durch kontextsensitive Platzhalter.

Pseudonymisierte Anfrage

Die Anfrage mit den kontextsensitiven Platzhaltern wird an das ausgewählte Large Language Model weitergeleitet.

Output mit kontextsensitiven Platzhaltern

Das LLM generiert seine Antwort inklusive kontextsensitiver Platzhalter, welche an das Pryvet Security Layer weitergeschickt werden.

De-Pseudonymisierung

Innerhalb des Pryvet Security Layers werden die kontextsensitiven Platzhalter wieder mit den ursprünglichen sensitiven Daten ausgetauscht.

De-pseudonymisierter Output

Die finale Antwort auf die Nutzeranfrage wird mit den ursprünglichen sensitiven Daten an den Nutzer bzw. das Nutzersystem weiter geleitet.

PII-API

Nutzen Sie unsere Erkennung von persönlich identifizierbaren Informationen und sensitiven Daten zur Einbindung in Ihre Systemlandschaft. Somit können diese erkannten Entitäten in internen Systemen weiter verwendet und angereichert werden.

PII-API

Nutzen Sie unsere Erkennung von persönlich identifizierbaren Informationen und sensitiven Daten zur Einbindung in Ihre Systemlandschaft. Somit können diese erkannten Entitäten in internen Systemen weiter verwendet und angereichert werden.

Die Power von KI – sicher und datenschutzgerecht

Mit Pryvet setzen Sie auf eine datenschutzgerechte Lösung, die Ihre sensitiven Daten pseudonymisiert und Ihnen den sicheren Zugang zu den bekanntesten Sprachmodellen ermöglicht.